Los CHATBOTS LOCALES están transformando la forma en que las organizaciones manejan información sensible. Cada vez más empresas buscan soluciones que no expongan datos a servicios externos, pero que mantengan capacidades avanzadas de I.A. GENERATIVA. Esto crea una oportunidad directa para profesionales que sepan implementar modelos como LLAMA o DEEPSEEK en entornos controlados.

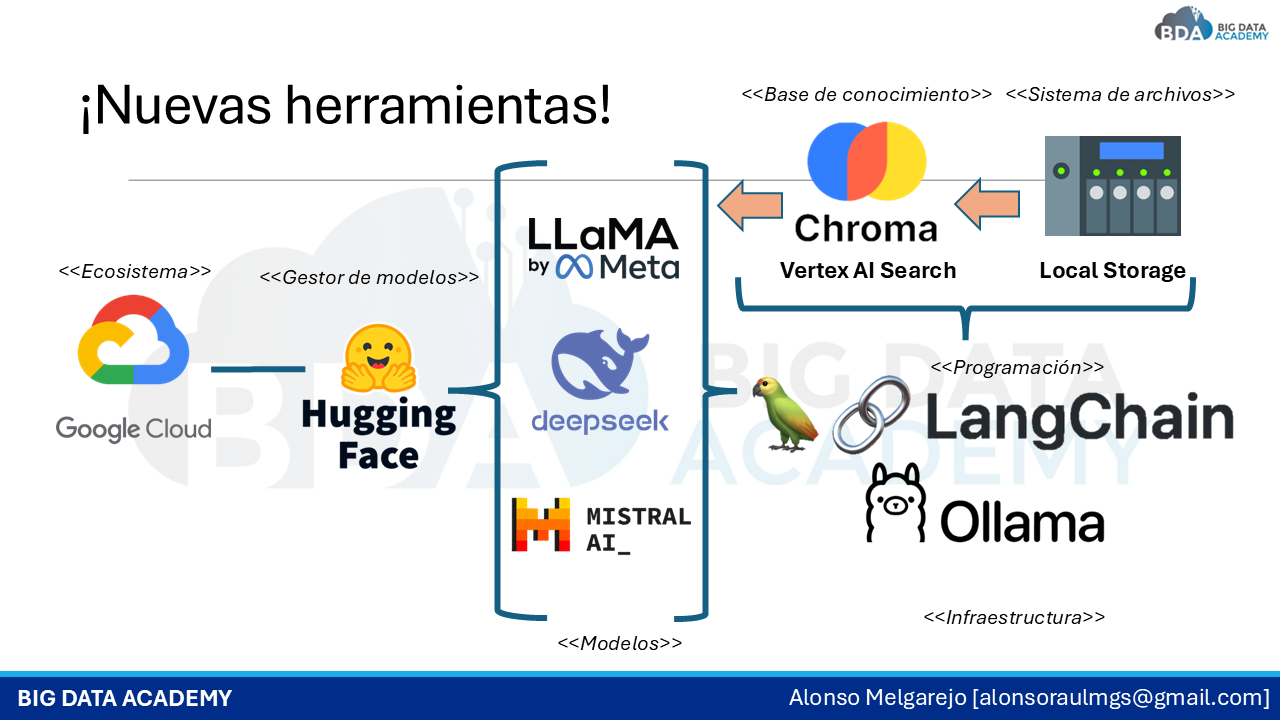

Hoy no basta con entender la teoría de los modelos de lenguaje. Las organizaciones necesitan especialistas capaces de ejecutar modelos con OLLAMA, integrarlos mediante LANGCHAIN y conectarlos a bases vectoriales locales para ofrecer respuestas precisas y contextualizadas. Estas competencias ya no son opcionales: son una ventaja competitiva en un entorno donde la SEGURIDAD y la soberanía de datos son prioridad.

La incorporación de memoria conversacional, el uso de embeddings locales y la construcción de arquitecturas RAG sin nube permiten desarrollar asistentes internos capaces de consultar documentos privados con eficiencia. Esto no es un experimento técnico: es una solución real para banca, gobierno e industria.

A nivel estratégico, dominar estas herramientas implica comprender cómo optimizar recursos de hardware, gestionar contexto y diseñar arquitecturas escalables sin depender de proveedores cloud. Este conocimiento técnico posiciona al profesional como alguien capaz de diseñar soluciones completas y sostenibles.

Para quienes buscan diferenciarse, la señal es clara: desarrollar habilidades en I.A. GENERATIVA LOCAL es una forma concreta de AUMENTAR SU VALOR PROFESIONAL y mantenerse relevante en un mercado cada vez más exigente.

¿Y cómo puedo aprender todo esto? 👇